Mistral hat das neue Flaggschiff-Modell Mistral Medium 3.5 vorgestellt, das Chat-, Reasoning- und Code-Funktionen in einem vereint. Das französische Unternehmen führt asynchrone Cloud-Agenten im Coding-Tool Vibe ein und aktualisiert Le Chat mit einem agentischen Modus. Mistral Medium 3.5 ist ein Dense-Modell mit 128 Mrd. Parametern und einem Kontextfenster von 256.000 Tokens, während Mistral Large 3 auf MoE mit 675 Mrd. Parametern setzt.

Hier die wichtigsten Fragen und Antworten:

- Was kann Mistral Medium 3.5 besser als Vorgänger?

Es vereint Chat, Reasoning und Code in einem Modell – weniger Wechsel, mehr Effizienz. 128 Mrd. Parameter sorgen für robustere Antworten, auch wenn die Inferenz teurer wird. - Warum ist das Kontextfenster von 256K Tokens wichtig?

Damit verarbeitet es lange Dokumente oder Codebasen ohne Gedächtnisverlust. Praktisch für Entwickler, die ganze Projekte analysieren lassen wollen – ohne ständiges Nachladen. - Dense vs. MoE: Was ist der Unterschied?

Dense-Modelle (wie Medium 3.5) nutzen alle Parameter pro Token – stabiler, aber kostspieliger. MoE (wie Large 3) aktiviert nur 41 Mrd. von 675 Mrd., spart Ressourcen, ist aber komplexer. - Wie verbessern asynchrone Cloud-Agenten in Vibe die Arbeit?

Sie führen Code im Hintergrund aus, während Sie weiterschreiben. Kein Warten mehr auf Ergebnisse – ideal für iterative Entwicklungsprozesse mit KI-Unterstützung. - Was bringt der „agentische Modus“ in Le Chat?

Er lässt das Modell selbstständig Aufgaben planen und ausführen. Statt nur zu antworten, agiert es wie ein (halbwegs) autonomer Assistent – mit allen Risiken von Halluzinationen. - Für wen lohnt sich Mistral Small 4?

Mit 119 Mrd. Parametern ist es der Kompromiss zwischen Leistung und Kosten. Gut für Nutzer, die kein MoE-Budget haben, aber mehr als Mini-Modelle brauchen. - Warum setzt Mistral auf zwei Architektur-Typen?

Dense-Modelle sind einfacher zu deployen und zu warten – ideal für Produkte. MoE spart Rechenleistung, erfordert aber mehr Feintuning. Strategische Flexibilität statt „One Size Fits All“. - Kann Medium 3.5 wirklich alles gleich gut?

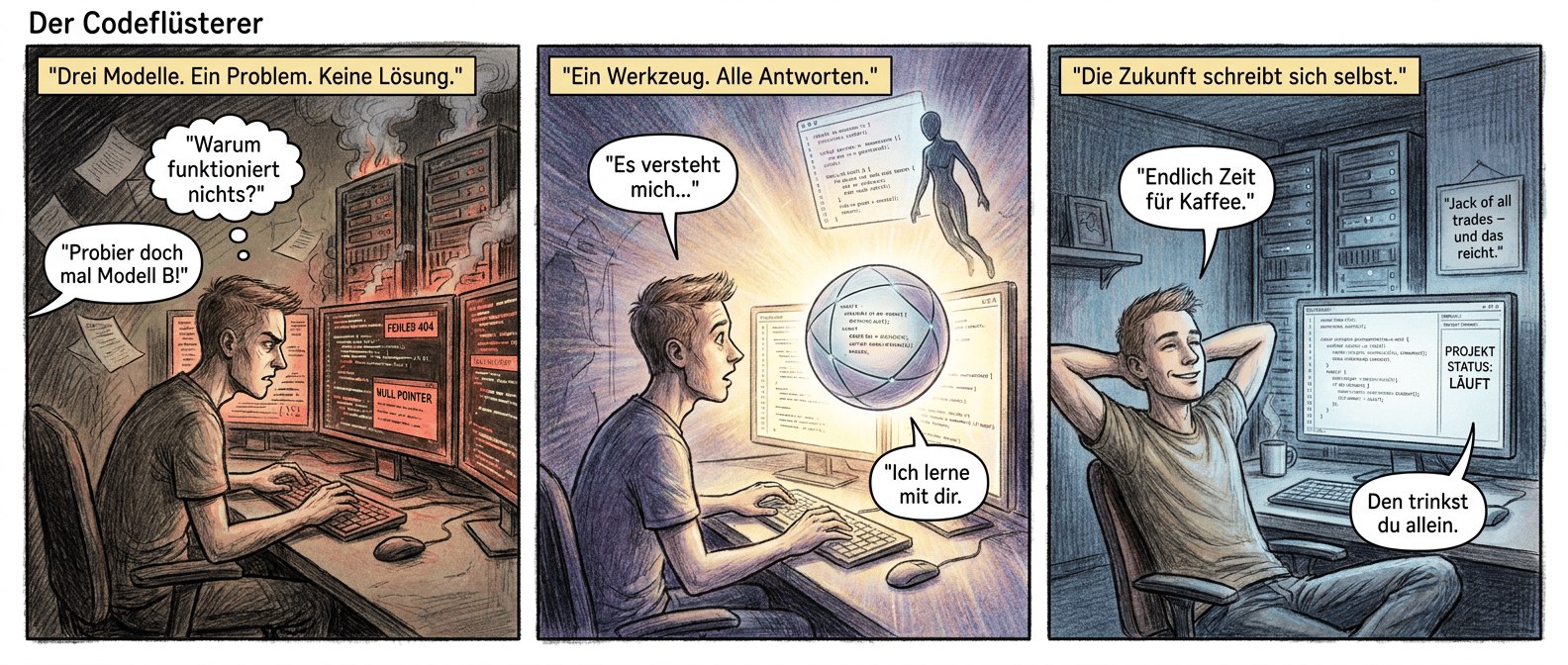

Nein, aber es reduziert die Notwendigkeit, zwischen spezialisierten Modellen zu wechseln. Trade-off: Jack-of-all-Trades, Master-of-none – für viele Anwendungen reicht’s trotzdem. - Wie teuer wird die Nutzung von Medium 3.5?

Dense-Modelle sind rechenintensiver, also vermutlich nicht billig. Mistral wird Preise anpassen – wer sparen will, greift vielleicht doch zu Small oder Large. - Wann kommen die neuen Features für alle Nutzer?

Kein offizielles Datum, aber Mistral rollt Updates meist schrittweise aus. Early Access für Partner, dann öffentliche Beta – Geduld ist eine Tugend (oder Folter). - Ist Mistral jetzt besser als GPT-4o oder Claude?

„Besser“ ist relativ: Medium 3.5 glänzt mit Integration, Large 3 mit Effizienz. Benchmarks kommen noch – aber Konkurrenz belebt das Geschäft (und die Modelle). - Was fehlt Mistral noch zum perfekten KI-Tool?

Mehr Transparenz bei Trainingsdaten, bessere Kontrolle über Agenten (Halluzinationen!) und stabilere APIs. Aber hey, Rome wasn’t built in a day – und auch nicht Mistral Large 4.