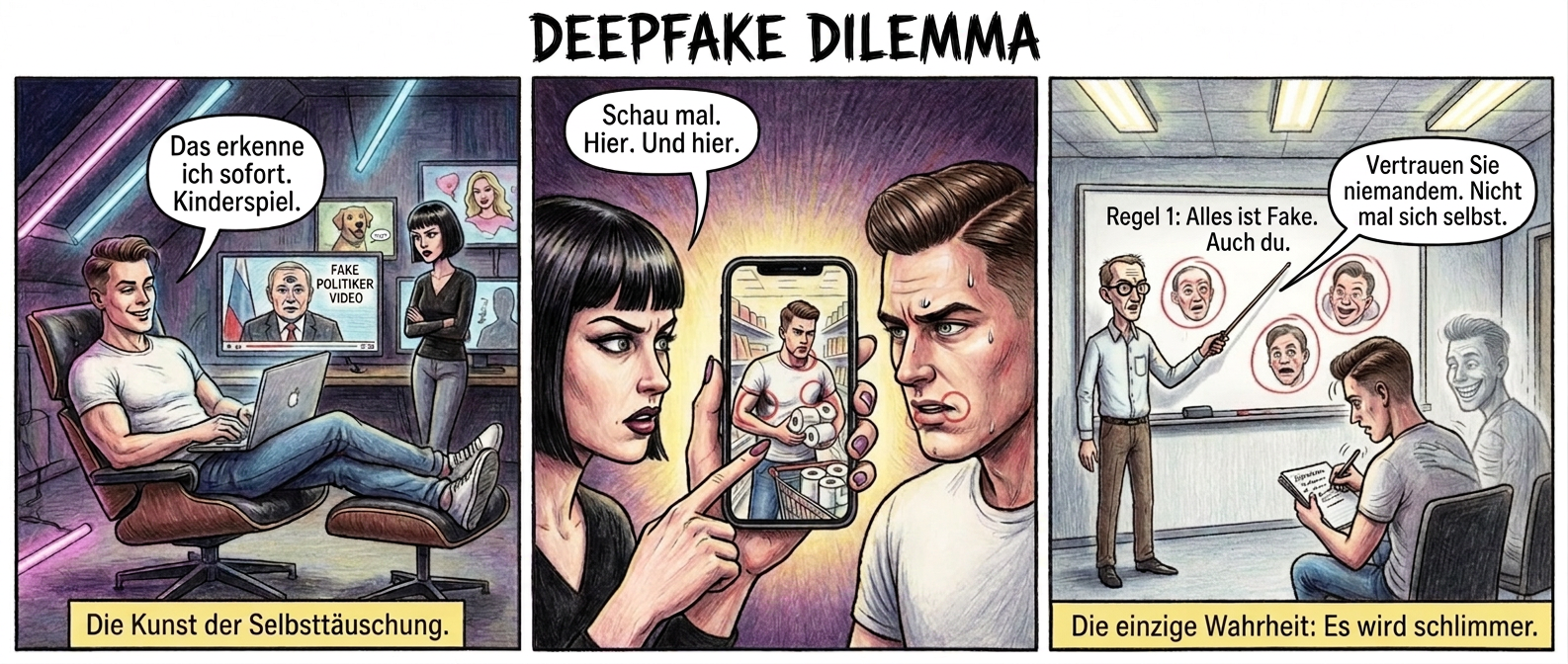

Viele Menschen in Deutschland glauben, sie könnten KI-generierte Inhalte wie Deepfakes problemlos erkennen – doch die Realität sieht anders aus. Eine aktuelle Studie zeigt: Fast die Hälfte der Internetnutzer ist überzeugt, Fälschungen durch künstliche Intelligenz zuverlässig zu entlarven. Doch in der Praxis gelingt das nur den wenigsten. Die meisten schauen nicht genau genug hin, um Manipulationen zu erkennen.

Die Untersuchung ist Teil einer Sonderauswertung des Cybersicherheitsmonitors 2026 und wurde vom Bundesamt für Sicherheit in der Informationstechnik (BSI) sowie der polizeilichen Kriminalprävention (ProPK) in Auftrag gegeben. Über 3.000 Personen nahmen daran teil. Das Ergebnis: Sieben von zehn Befragten sind bereits im Netz auf KI-generierte Bilder oder Videos gestoßen. Bei den unter 30-Jährigen sind es sogar neun von zehn.

Besonders alarmierend ist die Diskrepanz zwischen Selbstwahrnehmung und tatsächlichem Können. Viele Nutzer vertrauen zu sehr auf ihr Bauchgefühl, statt gezielt nach Hinweisen auf Manipulationen zu suchen. Experten warnen, dass Deepfakes immer schwerer zu erkennen sind – selbst für geschulte Augen. Die Studie unterstreicht daher die Notwendigkeit, die Bevölkerung besser über die Risiken von KI-Fälschungen aufzuklären.

Denn die Folgen können gravierend sein: Von gefälschten Nachrichten über betrügerische Videos bis hin zu manipulierten Stimmen – KI-Technologien werden zunehmend für Desinformation und Betrug missbraucht. Wer nicht weiß, worauf er achten muss, fällt leichter auf solche Tricks herein.

Die Autoren der Studie fordern mehr Aufklärung in Schulen, Medien und sozialen Netzwerken. Nur so lasse sich verhindern, dass KI-generierte Inhalte gezielt zur Täuschung eingesetzt werden. Gleichzeitig müsse die Technik hinter Deepfakes transparenter werden, um Fälschungen leichter identifizierbar zu machen.

Quelle: Heise