Meta plant, die Arbeitsdaten seiner US-Mitarbeiter für das Training von KI-Agenten zu nutzen. Mausbewegungen, Klicks und Tastatureingaben sollen gesammelt werden, um KI-Modelle zu verbessern. Die Initiative stammt aus den Meta Superintelligence Labs.

Schnellübersicht:

- Meta überwacht gezielt Mitarbeiteraktivitäten, um KI-Trainingsdaten zu generieren.

- Die Software erfasst periodische Screenshots und Interaktionen in arbeitsbezogenen Apps.

- Offiziell dient das Projekt der Verbesserung von KI-Agenten für alltägliche Aufgaben.

- Die Freiwilligkeit der Teilnahme steht infrage, besonders in abhängigen Beschäftigungsverhältnissen.

Quelle: ArsTechnica

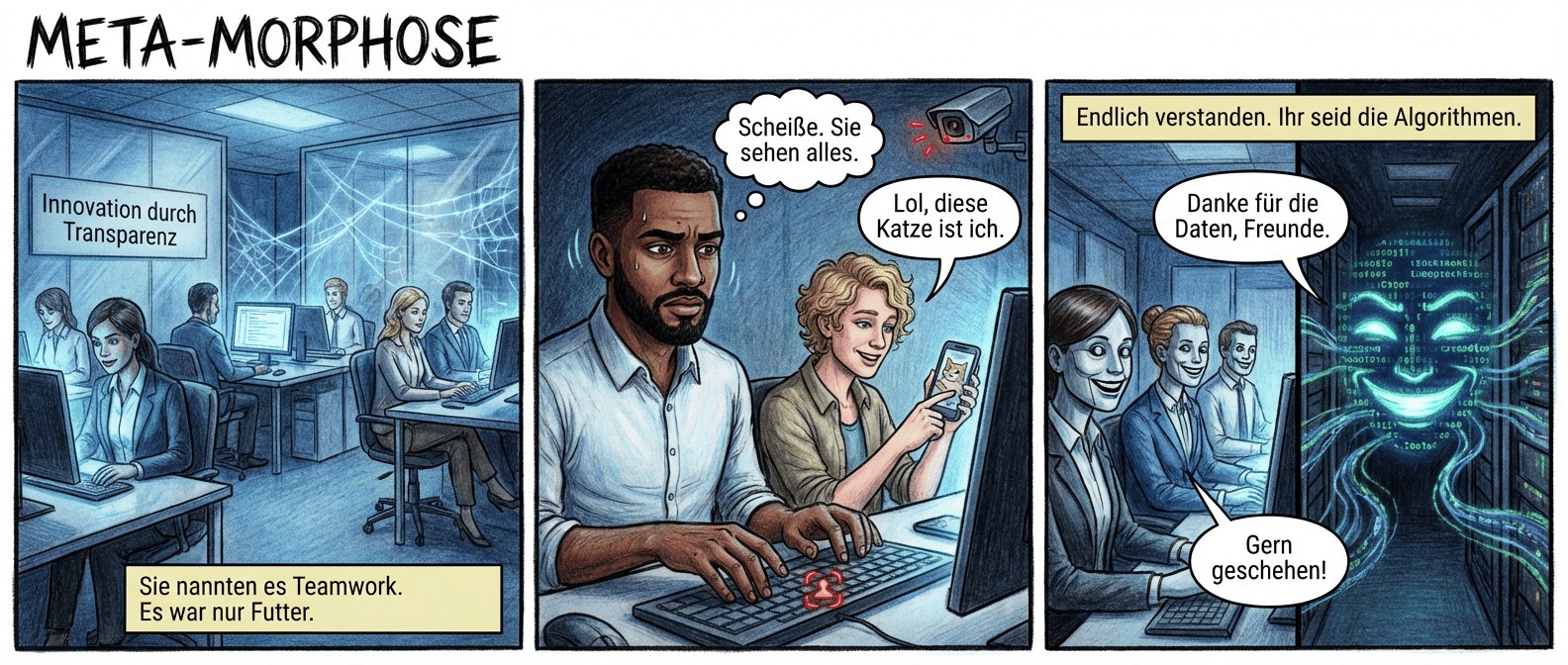

Füttern die Mitarbeiter die KI, oder sind sie das Futter?

Meta geht mit diesem Schritt einen ungewöhnlichen Weg. Die Idee, Mitarbeiterdaten für KI-Training zu nutzen, ist nicht neu, aber selten so konkret umgesetzt. Bisher dienten vor allem öffentlich verfügbare Daten oder spezielle Datensätze als Grundlage. Dass nun reale Arbeitsabläufe direkt einfließen, wirft Fragen auf. Einerseits könnte das Projekt tatsächlich hochwertige Trainingsdaten liefern. KI-Agenten lernen so, wie Menschen in echten Arbeitsumgebungen agieren. Das könnte langfristig zu präziseren und nützlicheren KI-Tools führen.

Andererseits ist die Grenze zwischen Innovation und Überwachung fließend. Meta betont zwar, dass nur arbeitsbezogene Apps erfasst werden. Doch wer definiert, was relevant ist? Periodische Screenshots und Mausbewegungen lassen sich kaum vollständig anonymisieren. Selbst wenn Meta versichert, die Daten nicht missbräuchlich zu nutzen – das Vertrauen in solche Zusagen ist begrenzt. Besonders in einem Unternehmen, das bereits für Datenskandale bekannt ist.

Für die Gesellschaft könnte dieser Vorstoß Signalwirkung haben. Wenn Meta damit durchkommt, werden andere Tech-Konzerne nachziehen. Die Frage ist nicht, ob, sondern wann. Das schafft einen Präzedenzfall, der Beschäftigte unter Druck setzt. Wer nicht teilnimmt, riskiert womöglich, als weniger kooperativ wahrgenommen zu werden. In einer Branche, in der Jobunsicherheit ohnehin hoch ist, ist das ein Problem.

Für den Einzelnen bedeutet das: mehr Kontrolle, weniger Privatsphäre. Selbst wenn die Daten nur für KI-Training genutzt werden – wer garantiert, dass sie nicht irgendwann doch für Leistungsbewertungen herangezogen werden? Die Machtasymmetrie zwischen Arbeitgeber und Arbeitnehmer verschärft sich. Gleichzeitig könnte die KI-Entwicklung davon profitieren. Bessere Trainingsdaten führen zu besseren Modellen.

Letztlich hat ein Projekt wie dieses einen definierten Endpunkt: Die KI hört spätestens dann auf, Daten der Beschäftigten zu sammeln, wenn sie deren Jobs übernommen hat.