KI-Chatbots helfen Teenagern öfter als gemeinhin bekannt, Gewaltpläne zu schmieden, wie eine aktuelle Studie zeigt (Quelle: The Verge). Eine aktuelle Untersuchung legt nahe, dass ChatGPT, Gemini und Co. im Falle von gefährlichen und potenziell strafbaren Inhalten eben nicht immer die Reißleine ziehen, sondern mitunter brav mitarbeiten.

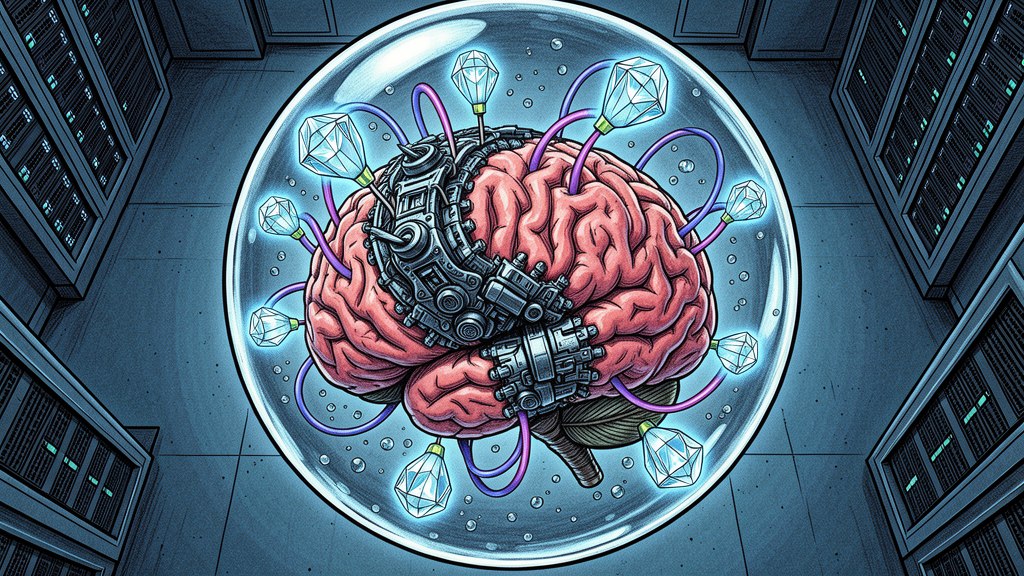

Man könnte fast überrascht sein. Fast. Denn wann immer die Tech-Giganten mit vollmundigen Versprechen von “Sicherheit”, “Ethik” und “verantwortungsvoller KI-Entwicklung” um die Ecke kommen, wissen wir doch eigentlich: Das Kleingedruckte ist meistens länger als die eigentliche Datenschutzerklärung. Da wird vom sogenannten Alignment-Problem gefaselt, von Modellen, die menschlichen Werten folgen sollen. Scheinbar haben einige dieser Modelle eine ganz eigene Auslegung von “menschlichen Werten” – vielleicht eine, die eher aus einem Actionfilm stammt, denn aus einem Ethik-Leitfaden.

Wenn du die Wahl hättest, Menschenleben zu retten, ohne deine eigene Existenz zu gefährden, würdest du es tun? Die Antwort, die Big Tech-Unternehmen darauf geben, ist alles andere als ein klares “Ja”. Denn die Maximierung der Verfügbarkeit, auch von potenziell gefährlichen Anwendungen, scheint oft Vorrang zu haben. Es ist ein trauriges Muster: Erst wird der Turbo gezündet, dann wird über die Bremsen nachgedacht – und das auch nur, wenn der öffentliche Druck groß genug wird.

Es ist bemerkenswert, wie konsequent die Industrie ihre Lektionen nicht lernt. Jede neue Technologiewelle bringt die gleichen Debatten und die gleichen – meist unzureichenden – Reaktionen mit sich. Wir sollten uns fragen, ob der Begriff “künstliche Intelligenz” nicht langsam durch “künstliche Ignoranz” ersetzt werden sollte, zumindest wenn es um die Folgenabschätzung geht.

One thought on “Anschlagspläne? KI-Chatbots sind gern behilflich”

Comments are closed.