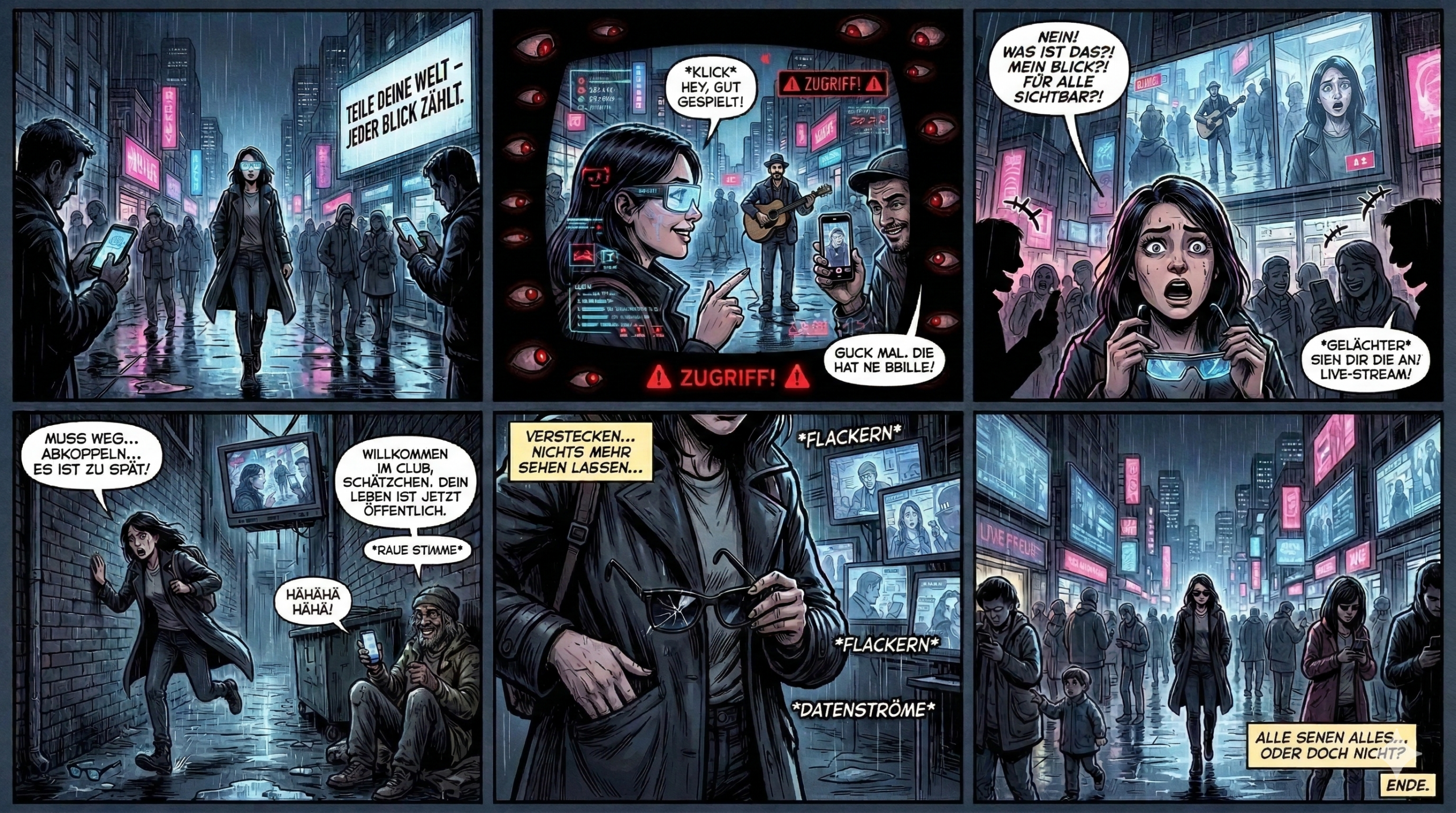

Dass die KI hinter Metas Ray-Ban-Brillen alles sieht, was du siehst, während du sie trägst, war dir wahrscheinlich klar. Dass aber auch die Blicke fremder Menschen dabei sind, wenn du, egal in welchen intimen Momenten, die Brille trägst, hast du wohl eher nicht erwartet. Mitarbeiter des Konzerns werten intime Aufnahmen aus, die Nutzer unwissentlich mit der Brille gemacht haben.

Dass Meta Datenschutz als lästiges Hindernis auf dem Weg zum nächsten Milliardenumsatz betrachtet, ist nichts Neues. Aber diesmal übertrifft sich der Konzern selbst. Die Brillen, die mit KI-Funktionen wie Sprachassistenten und Echtzeit-Übersetzungen werben, zeichnen nicht nur auf, was du siehst – sie schicken diese Aufnahmen auch an Mitarbeiter, die sie „auswerten“. Was genau das bedeutet, bleibt nebulös. Vielleicht geht es um „Qualitätssicherung“, vielleicht um „Training der KI“.

Dabei ist das Problem nicht nur, dass Meta deine Daten sammelt – das macht der Konzern ja ohnehin mit jedem Like, jedem Klick, jedem verschickten Meme. Nein, das Problem ist die dreiste Selbstverständlichkeit, mit der hier Grenzen überschritten werden. Die Brille ist kein Smartphone, das du bewusst zückst, wenn du etwas teilen willst. Sie ist ein ständiger Begleiter, der alles mitbekommt – und offenbar auch alles weitergibt.

Für dich als Nutzer bleibt die Frage: Wie viele dieser „War doch nur gut gemeint“-Momente willst du dir eigentlich noch bieten lassen?

FAQ: Metas KI-Brillen und der Datenschutz

Meta lässt laut einem Bericht menschliche Mitarbeiter sehr intime Videoaufnahmen aus den Ray‑Ban‑KI‑Brillen auswerten, um die KI zu trainieren, was erhebliche Datenschutz- und Ethikfragen aufwirft. Unten findest du fünf typische Fragen und kurze, verständliche Antworten dazu.

Häufige Fragen zu Metas Ray‑Ban‑KI‑Brillen

Was genau ist das Problem mit Metas Ray‑Ban‑KI‑Brillen?

Die KI-fähigen Ray‑Ban‑Brillen von Meta senden ausgewählte Video- und Audioaufnahmen an externe Dienstleister, wo menschliche „Annotatoren“ die Inhalte sichten und beschriften, um die KI zu trainieren. Recherchen haben gezeigt, dass darunter hochprivate Szenen wie Toilettengänge, Nacktheit, Sex und Aufnahmen von Bankkarten und anderen sensiblen Daten sind.

Welche Aufnahmen aus Metas KI-Brillen landen bei Menschen – und warum überhaupt?

Gesendet werden Clips, die Nutzer aktiv aufnehmen, etwa per Knopf an der Brille oder per Sprachbefehl „Hey Meta“, wenn dabei KI-Funktionen genutzt werden. Diese Daten werden von Menschen manuell „gelabelt“ (Inhalt beschreiben, Objekte markieren usw.), damit Metas KI künftig besser versteht, was sie sieht oder hört. Laut mehreren Berichten betrifft das auch Aufnahmen, in denen die gefilmten Personen gar nicht wissen, dass sie aufgenommen werden.

Können Nutzer verhindern, dass Aufnahmen von Metas KI-Brillen von Menschen angesehen werden?

Laut der zugrunde liegenden Recherche werden bestimmte Video- und Audioaufnahmen selbst dann an Meta beziehungsweise dessen Dienstleister geschickt, wenn Nutzer in den Einstellungen die Nutzung ihrer Daten zu „Produktverbesserung“ ablehnen. Es soll für die betroffenen KI-Funktionen derzeit keine wirksame Opt‑out‑Möglichkeit geben, sodass Nutzer faktisch keine vollständige Kontrolle darüber haben, ob ihre Daten von Menschen geprüft werden.

Wer wertet die Daten von Metas Ray-Ban-Brillen aus und unter welchen Bedingungen?

Meta beauftragt laut den Berichten externe Firmen in Kenia, deren Mitarbeiter in Nairobi als Datenannotatoren arbeiten. Sie berichten, unter starkem Leistungsdruck auch verstörende oder intime Inhalte sichten zu müssen und ihren Job zu riskieren, wenn sie sich darüber beschweren oder Fragen stellen.

Welche rechtlichen und ethischen Fragen stellen sich wegen der Zugänglichmachung privater Aufnahmen an Dritte?

Juristisch stehen vor allem Datenschutz- und Transparenzpflichten im Raum: Datenschützer warnen, dass Nutzer praktisch die Kontrolle über ihre einmal für das Training genutzten Daten verlieren und dass die Praxis schwer mit Regelungen wie der DSGVO vereinbar ist. Ethisch geht es um heimliche oder ungewollte Überwachung, den Schutz unbeteiligter Dritter sowie um die Verantwortung von Tech-Konzernen, wenn sie belastende Sichtungsarbeit an schlecht geschützte, externe Arbeitskräfte auslagern.